들어가며

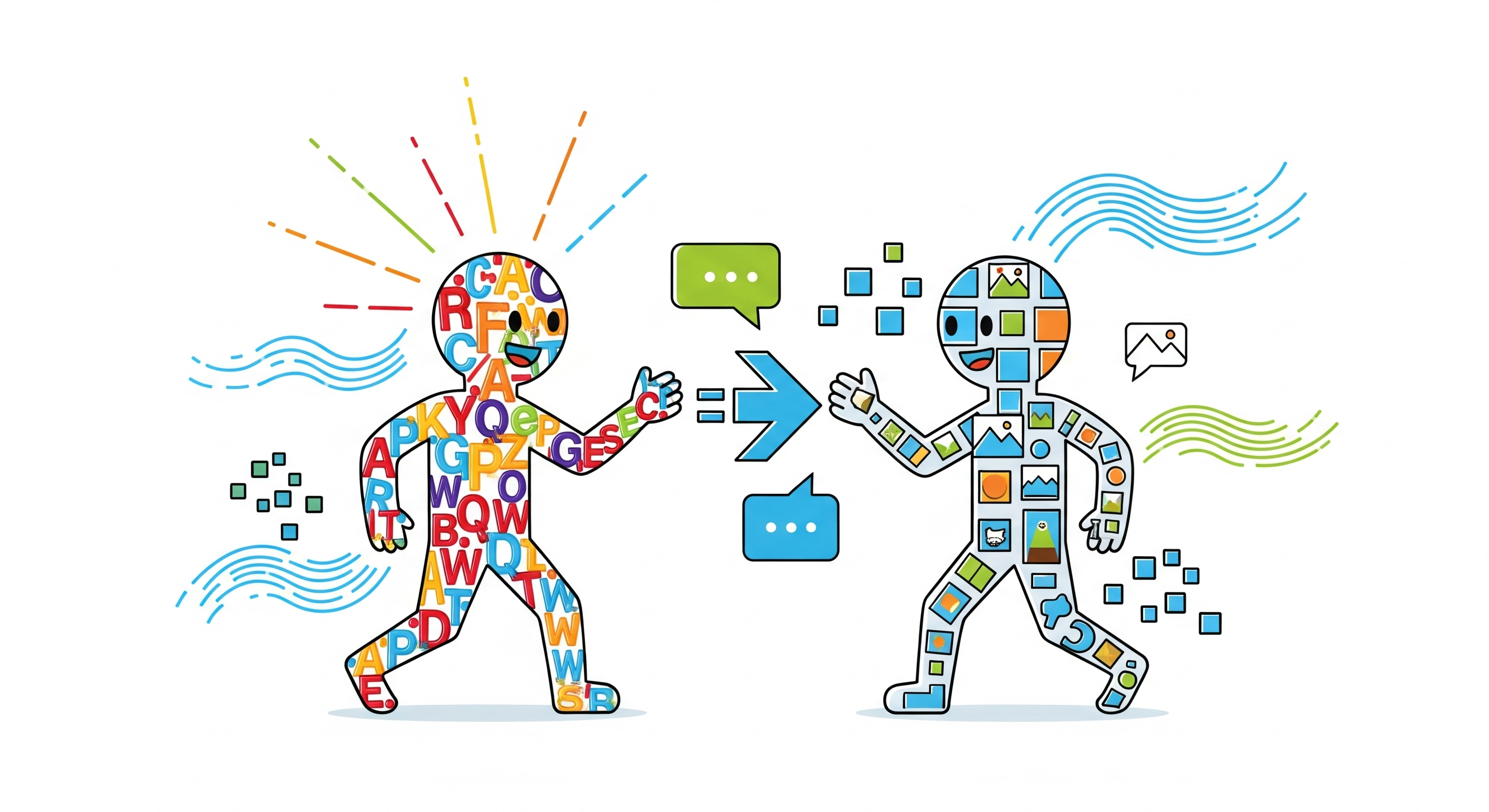

현재 대부분의 생성형 AI 시스템은 텍스트를 생성하는 언어모델(LLM)과 이미지를 생성하는 비전 모델이 서로 독립적으로 작동하고 있다. 이로 인해 발생하는 문제는 앞 장들에서 반복적으로 확인했다. 그렇다면, LLM과 이미지 모델을 통합하거나, 하나의 엔진으로 글과 그림을 동시에 이해하고 생성하는 것은 가능할까?

이번 장에서는 기술적인 현실과 향후 발전 방향에 대한 전망을 함께 살펴본다.

언어모델 vs 이미지모델 – 구조적 차이

| 항목 | 언어모델 (LLM) | 이미지 생성 모델 |

| 입력 방식 | 텍스트 (문장 단위의 시퀀스) | 텍스트 또는 이미지 텍스트 혼합 |

| 출력 형식 | 자연어 문장 | 픽셀 기반 이미지 |

| 주요 처리 방법 | 다음 단어 예측을 기반으로 문맥 유지 | 디퓨전/트랜스포머 구조로 이미지 생성 |

| 강점 | 지식 요약, 설명, 대화, 논리 구조 | 스타일, 조형미, 구도, 표현력 |

| 약점 | 공간적 이해와 시각 인식 결여 | 언어적 맥락 처리 능력이 낮음 |

왜 지금은 통합이 어려울까?

- 모델 크기와 복잡성의 차이

- 텍스트와 이미지를 동시에 정교하게 처리하려면 모델이 매우 크고 복잡해짐 - 멀티모달 학습의 어려움

- 텍스트 + 이미지 + 맥락을 함께 학습하는 데이터셋이 제한됨

- 예: “이 문장은 저 그림을 설명한다”는 식의 정밀한 정합 데이터 부족 - 출력 목적의 차이

- 문장은 연속적, 논리적 서사에 적합하고

- 이미지는 병렬적이고 직관적인 정보 표현에 최적화됨 - 현재는 파이프라인 구조로 동작

- 텍스트 생성 → 이미지 생성 순차 처리 → 정보 유실 가능성 발생

향후 통합 가능성

- 멀티모달 LLM의 등장: 텍스트 + 이미지 + 음성 등 다양한 입력을 동시에 다루는 LLM이 개발 중

- 공통 벡터 표현학습: 언어와 이미지를 같은 의미 공간에 위치시키는 기술이 빠르게 발전 중

- 문맥 일관성 향상: 이미지가 문장의 의미를 반영할 수 있도록 강화된 가중치 전략 도입

- 예측 가능한 상호작용: 사용자가 그림을 클릭하면 관련 문장 강조 등 인터랙티브 문서 기술도 기대됨

실제로 최근 일부 AI는 이미지에 포함된 정보에 질문을 하고, 그 답변을 다시 그림으로 반영하는 형태의 흐름도 테스트되고 있다. 아직 초기 단계지만, 언어와 시각이 연결되는 미래는 현실로 다가오고 있다.

이 장의 요약

- 언어모델과 이미지모델은 현재 구조적으로 분리되어 있으며, 역할과 강점도 다르다.

- 텍스트와 그림이 통합된 창작은 지금은 파이프라인 방식으로 우회적으로 구현되고 있다.

- 향후에는 멀티모달 LLM의 발전으로 글과 그림이 자연스럽게 연결되는 시대가 열릴 가능성이 높다.

'AI 프롬프트' 카테고리의 다른 글

| 10장. 복합 문서 작성자에게 권장되는 워크플로우 – 실전 작성법 제안 (0) | 2025.07.08 |

|---|---|

| 9장. 현재의 우회 방법 – 생성 이미지 디렉션의 팁과 전략 (1) | 2025.07.08 |

| 7장. 언어로 설명하기 어려운 행동 표현 – AI 모델이 '못 보는' 장면들 (1) | 2025.07.08 |

| 6장. 정확한 시각 표현이 어려운 예시들 – 요가, 종이접기, 조립 설명서 (4) | 2025.07.08 |

| 5장. 생성형 AI의 이미지 생성 방식 – 왜 디테일이 빠질까 (3) | 2025.07.08 |